"Ich, ein Guru der mobilen Touchscreens, bekomme nicht mal diese Bankautomaten zum Laufen", erzählte mir Josh Clark, Autor von Topworthy, als wir über die Schwierigkeiten bei der Nutzung der touch-basierten Geldautomaten der Bank of Amerika sprachen. Bei diesen Touchscreens ist die Kalibrierung in regelmäßigen Abständen dahin, die Interaktion ist frustrierend.

Mit der Einführung des iPhones von Apple ist die Berührung zu einem gebräuchlichen, ganz normalen Eingabemechanismus geworden und hat sich im Leben der Leute verankert. Doch diese Technologie gibt es schon seit Jahrzehnten.

Meine erste Berührung

An meinem ersten Touch-Display habe ich in den 70-ern gearbeitet, als ich eine Kiosk-Technologie entwickelte, die eventuell an Orten wie Disneys EPCOT Center eingeführt werden sollte. Damals war die Technologie plump, oft ging die Kalibrierung verloren und außer einem einzelnen festen Draufdrücken wurde nichts unterstützt.

Ziehen und Schieben war nicht möglich, denn die Eingabetechnik konnte mit Bewegungen nicht umgehen und die Prozessoren waren nicht schnell genug, um den Cursor in Echtzeit darzustellen. Es ist seltsam, wenn Sie mit dem Finger über den Bildschirm fahren und die Cursor-Bewegung Sekunden hinterherhinkt.

Die Geburt der direkten Manipulation

Seinerzeit waren unsere Möglichkeiten in Sachen Berührungssteuerung also sehr limitiert. Aber die Berührung war nicht die einzige beschränkte Technologie. Bevor mit der Einführung des Macintosh anno 1984 die Computermaus populär wurde, bewegten wir uns mithilfe von Tastaturkommandos über den Bildschirm. Die Pfeiltasten waren oft sehr ungünstig und ineffizient positioniert, also war die Nutzung von Shortcuts wie Strg+D für eine Linksbewegung und Strg+E für hoch gängig.

Unsere Nutzer erlernten diese Interaktionen durch Training, oft im Rahmen von Zuschauen-und-Nachmachen-Schulungen oder durch das Studium von Handbüchern und ständige Praxis. Damals gab es keine Möglichkeit, diese Dinge zu lernen, indem man sich einfach den Bildschirm anschaute. (Einige Anwendungen wie z.B. Wordstar verbrauchten beträchtlichen Screen Real Estate für ständige Erklärungen, wie man den Cursor bewegt.)

Als die Maus dann aufkam, konnten wir den Pfeil aus dem Handgelenk über den Bildschirm bewegen, statt ständig und wiederholt auf Tasten drücken zu müssen. Wir konnten ein Objekt per Klick auswählen und es in einigen Fällen sogar an eine andere Stelle des Bildschirms ziehen.

Das war die Geburtsstunde der direkten Manipulation. Ironischerweise wissen wir heute, dass sie so direkt gar nicht ist. Man bewegt ein Objekt auf der Schreibtischoberfläche, um einen Cursor auf dem Bildschirm zu kontrollieren. Zwischen diesem Konzept und dem des In-die-Hand-Nehmens und Berührens liegen Welten.

Ich erinnere mich an User-Tests mit unerfahrenen Nutzern in den frühen Tagen der Maus: Wenn sie eine Aufgabe wie "Drücke den Schließen-Button" hatten, nahmen sie die Hand von der Maus und drückten mit dem Finger tatsächlich auf den Bildschirm. Natürlich passierte dabei nichts – außer dass es die armen Nutzer noch mehr verwirrte.

Berührungsbewegungen verstärken das Discoverability-Problem

Obwohl es in jenen frühen Maustagen jede Menge Limitierungen gab, hatten wir doch Schwierigkeiten, den Usern zu zeigen, was sie tun konnten. Wenn man nicht wusste, dass man das Laufwerks-Icon in den Papierkorb ziehen musste, um die Disc auszuwerfen – wie sollte man darauf kommen? Dieses Problem ist nicht vom Tisch, vielmehr ist es mit der neuen Touchscreen-Technologie noch schlimmer geworden.

"Es gibt ein massives Problem mit der Discoverability", sagte Josh mir in jenem Interview. "Für Bewegungen und Gesten gibt es keine Buttons. Sie sind unsichtbar. Man muss sie finden."

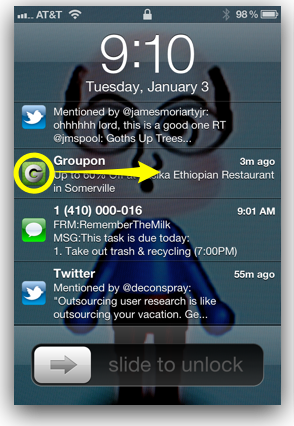

Beispielsweise bekommen die meisten Nutzer des neuen iOS5-Systems von Apple nicht mit, dass sie im Gesperrt-Modus einfach das Icon ziehen können, um das Gerät zu entsperren und zugleich die App direkt zu öffnen. So etwas weiß man nicht, wenn es einem niemand sagt.

Abb. 1: Die meisten User wissen nicht, dass sie das Gerät entsperren können, indem sie das Notification-Icon ziehen.

Komplexe Bewegungen funktionieren als Shortcuts und Abkürzungen bestens, aber nur solange die Nutzer auch ans Ziel kommen, ohne sie zu kennen. Nachdem Twitter kürzlich seine iOS-interne Anwendung aktualisiert hatte, waren häufig genutzte Features wie Direct Messages plötzlich aus der Hauptnavigation verschwunden und auf Sub-Screens ausgelagert worden. Für einen normalen Nutzer gab es keine Möglichkeit, die versteckte Bewegung zum Öffnen des Direct-Messages-Bildschirms zu entdecken.

Das Discoverability-Problem wächst mit der Anzahl der Berührungsbewegungen. Designer und Konzeptionierer werden nicht umhinkommen, eine Balance zwischen dem Bedürfnis nach gestenbasierter Steuerung und dem Visuell-unzugänglich-Machen von Features zu finden. Nutzer finden Abkürzungen toll, aber nur wenn sie wissen, dass es sie gibt.

Skeuomorphismus, der frustriert

Wenn eine neue Eingabetechnologie zugänglich wird, öffnet sich damit eine Welt von Möglichkeiten. Beim ersten Experimentieren werden aber häufig bekannte und gewohnte Eigenschaften integriert.

Als die Computermaus und bessere grafische Darstellungsmöglichkeiten zum Standard auf allen Rechnern geworden waren, sahen wir Experimente wie diese: Microsoft Bob versuchte beispielsweise, der Arbeit mit Dateien einen "natürlichen" Anstrich zu geben, indem das Bild eines Aktenschranks mit Schubladen integriert wurde, das man manipulieren konnte. Southwest Airlines experimentierte auf der ersten Website mit dem Bild eines Ticketschalters.

Das Kopieren von Elementen aus der realen, anfassbaren Welt ist als Skeuomorphismus bekannt. Die Intention ist, dem Nutzer etwas Vertrautes und Bequemes zu liefern.

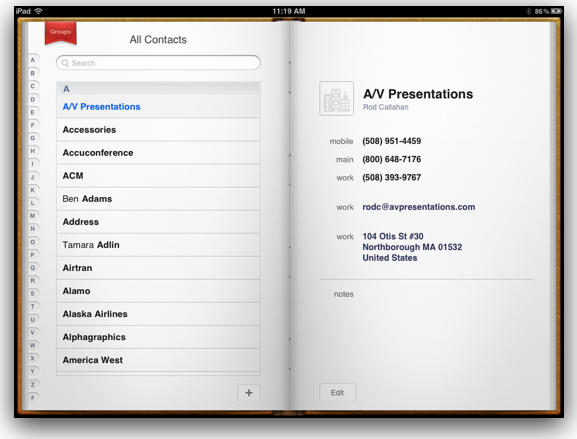

Abb. 2: Nutzer haben Erwartungen an skeuomorphe Oberflächen.

Das Problem mit skeuomorphen Oberflächen besteht darin, dass sie sich häufig nicht verhalten wir ihre Pendants aus dem echten Leben. Ein gutes Beispiel ist das Contact Book des iOS. Josh dazu: "Es sieht aus wie ein Buch. Aber es lässt einen die Seiten nicht umblättern wie in einem Buch." Nutzer haben Erwartungen, wie sich diese Gegenstücke der Real-World-Elemente verhalten sollten.

"Wenn es mehr als bloßes Augenfutter sein soll", so Josh weiter, "muss man diese Interface-Metaphern konsistent durchziehen." Skeuomorphe Oberflächen können funktionieren, aber sie müssen viele Funktionen der Elemente nachahmen, die Pate gestanden haben.

Ein neues Vokabular definieren

Während Entwicklungsteams damit experimentieren, was mit diesen Gesten und Bewegungen alles möglich ist, beobachten wir, wie eine Sprache entsteht. Apple hat für mobile Geräte das Löschen per horizontalem Ziehen eingeführt. Viele Hersteller haben diese Bewegung für die Löschen-Aktion übernommen.

Aber Josh weist auch darauf hin, dass das enorme Tempo, mit dem Applikationen auf der Bildfläche erscheinen, zu Konflikten führt: "Man muss unterschiedliche Gesten erlernen, um ein Magazin in verschiedenen Magazin-Apps zu lesen. Hier muss eine Vereinheitlichung her."

Josh sieht zunächst eine ziemlich konfuse Zeit kommen, bevor irgendwann die Bewegungen über die Geräte und Apps hinweg standardisiert sind. Er legt Entwicklungsteams ans Herz, genau zu beobachten, was die anderen tun, ehe man eine neue Bewegung einführt. Möglicherweise hat schon jemand einen guten Weg gefunden, um eine ähnliche Aktion durchzuführen.

Eine Möglichkeit ist die Katalogisierung dessen, was schon gemacht wurde. "Seit einiger Zeit denke ich darüber nach, eine Bibliothek mit Bewegungsmustern zusammenzustellen", sagte Josh mir. "Wie könnten wir anfangen, eine solche Sammlung zu nutzen?"